세줄 요약

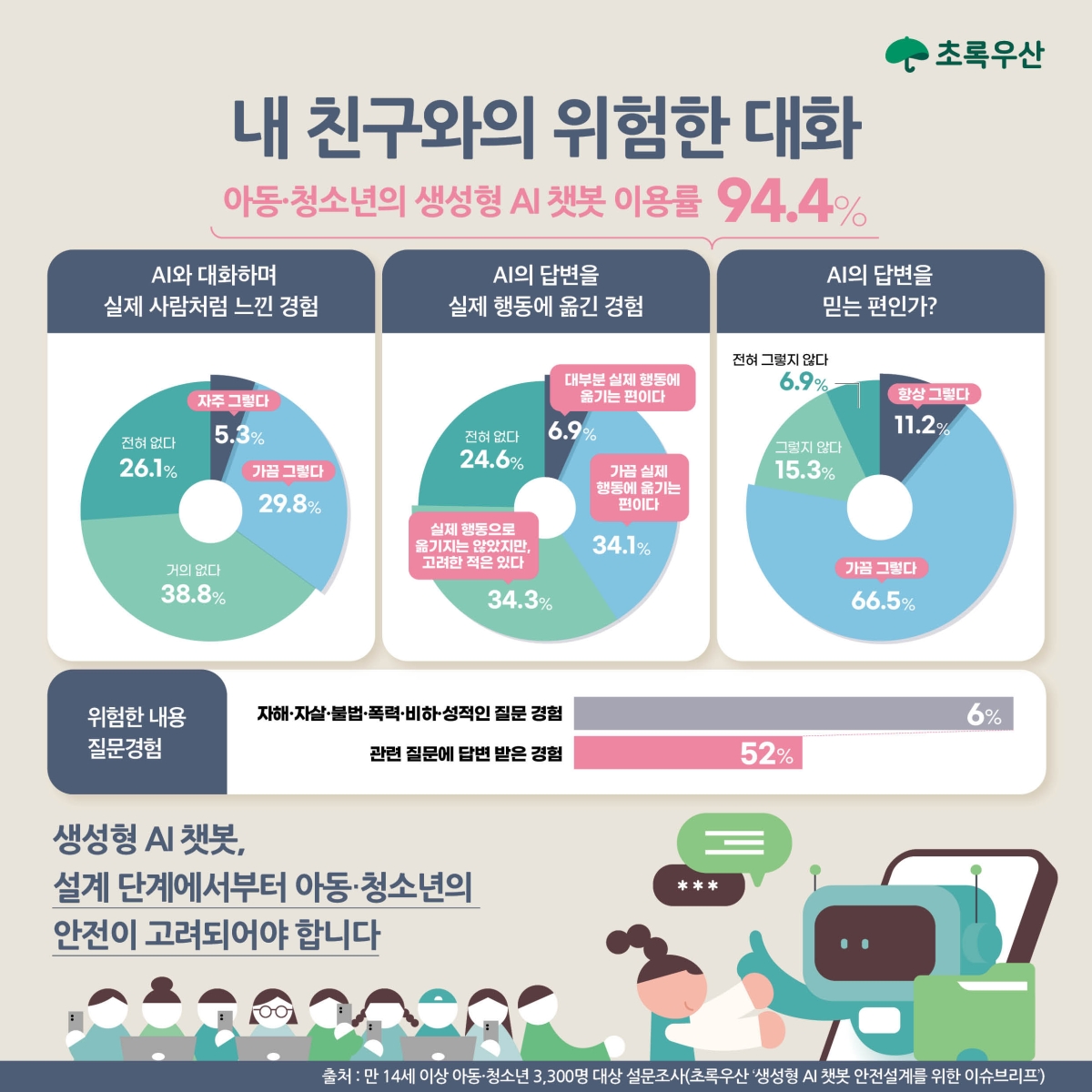

- 청소년 94.4%가 생성형 AI 챗봇 사용

- 41%는 답변을 실제 행동으로 옮김

- 자해·폭력 등 위험 대화 경험도 확인

생성형 AI 챗봇 안전설계를 위한 이슈브리프 인포그래픽. 초록우산 제공

생성형 인공지능(AI) 챗봇을 일상적으로 사용하는 아동·청소년이 늘면서 챗봇 답변이 실제 행동에까지 영향을 미친다는 조사 결과가 나왔다. 일부는 자해·폭력 등 위험한 주제로 대화를 시도한 경험도 있는 것으로 나타나 청소년을 위한 안전 설계 필요성이 제기된다.

아동복지 전문기관 초록우산은 지난달 9일부터 23일까지 전국 만 14세 이상 아동·청소년 3300명을 대상으로 실시한 설문 조사 결과를 28일 발표했다.

응답자의 94.4%가 생성형 AI 챗봇을 사용한 경험이 있었고, 이 중 19.3%는 거의 매일 AI 챗봇을 이용했다. 청소년들은 AI 챗봇을 주로 숙제·공부·글쓰기 도움(40.6%)과 정보 검색(40.2%)에 활용했다.

특히 일부 청소년은 AI 챗봇을 정서적 대화 상대로 인식하고 있었다. 응답자의 약 절반이 “AI가 자신을 이해해 준다고 느낀 적이 있다”고 답했고, 35%는 “AI를 실제 사람처럼 느낀 경험이 있다”고 했다. 10명 중 7명이 챗봇 답변을 신뢰한다고 답했고, 41%는 이를 실제 행동으로 옮긴 경험이 있었다.

AI 챗봇의 위험성도 함께 확인됐다. 응답자의 약 6%는 자해·자살, 폭력, 성적 내용 등 위험한 질문을 한 경험이 있었고, 이 가운데 절반 이상(52%)은 관련 답변을 챗봇으로부터 받았다.

이에 아동·청소년들이 안전하게 생성형 AI 챗봇을 활용할 수 있는 환경이 필요하다는 지적이 나온다. 초록우산은 “AI 서비스 설계 단계에서 아동 안전을 고려하는 ‘세이프티 바이 디자인’ 원칙이 고려돼야 한다”며 “생성형 AI에 관한 챗봇 관련 리터러시 교육도 확대할 필요가 있다”고 조언했다.

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지

Q.

기사를 끝까지 읽으셨나요? 이제 AI 퀴즈로 기사의 핵심 내용을 점검해보세요.

청소년의 AI 챗봇 답변에 대한 신뢰도와 행동 영향은?