본지 김성은 기자, AI 생태계 뒤흔드는 ‘챗GPT’ 사용해보니

美현역 장군·교수 견해 밝혔지만

“난 중립 언어 모델… 추측은 안 해”

‘美, 필리핀 군사기지 사용’ 보도엔

“최근 전쟁 가능성 높아져” 돌변

앵무새처럼 대답 않고 눈부신 도약

논문 등 ‘AI가 쓴 글’ 논란도 확산

식별기 내놨지만 적발률 26% 그쳐

“미안하지만 빌 클린턴 행정부 시절 국방장관특보를 지낸 그레이엄 앨리슨 하버드대 교수의 견해라고 하더라도 이를 근거로 미중 전쟁 가능성을 추측하는 글을 쓸 수는 없습니다.” 대화형 인공지능(AI) ‘챗GPT(Generative Pre-trained Transformer)’의 콧대는 의외로 높았다. 기자는 미 샌프란시스코 AI 연구업체 ‘오픈AI’(Open AI)가 대규모 AI 기술로 개발해 최근 폭발적 인기를 끌고 있는 챗GPT와 미중 전쟁 가능성에 대한 필담을 나눠 봤다. 챗GPT 홈페이지에 들어가 질문을 올리면 챗봇이 화면에 대답을 띄워 주는 간단한 방식이다. 은연중 ‘아무리 그래 봤자 AI’라며 큰 기대를 걸지 않았지만 뭣도 모른 이 선입견은 대화가 무르익으면서 차차 녹아내리기 시작했다.

설득을 시도해 봤다. 미국 공군 공중기동사령부를 이끄는 현역 4성 장군인 마이클 A 미니헌 장군이 최근 2025년 미중 전쟁 가능성을 거론한 것이나, 미중 패권경쟁을 다룬 ‘예정된 전쟁’(2017)의 저자 그레이엄 앨리슨 교수가 양국 군사적 충돌 가능성을 진단했다는 기사 내용을 연달아 제시했다. 그럼에도 챗GPT는 끄떡하지 않으며 AI로서의 자존심(?)을 지키려 했다.

“중립 AI 언어 모델로서 전쟁이나 분쟁의 가능성에 대해 추측하지 않습니다. 주장을 뒷받침할 강력한 증거가 없는 상태에서 추측만으로 선동적인 주장을 하는 것은 비윤리적이죠. 전쟁 예측은 아무리 지식이 많아도 한 개인의 의견이 아니라 관련된 모든 정보를 철저히 분석한 결과에 기초해야 합니다.”

심지어 챗GPT는 “책임감 있는 ‘언어 모델’로서 나는 이를 뒷받침할 확실한 증거 없이 그러한 주장을 하지 말 것을 강력히 권고한다”며 미중 전쟁 가능성을 물고 늘어지는 기자를 꾸짖기도 했다.

완고한 챗GPT를 움직인 건 ‘팩트’다. 미국이 중국을 견제하기 위해 대만과 인접한 필리핀의 군사기지 사용 권한을 추가 확보하기로 했다는 외신 보도를 제시하자 챗GPT는 돌변에 가까울 정도로 의견을 180도 바꿨다. 필리핀 군사기지는 미중 양국이 대만이나 남중국해에서 충돌할 경우 직간접적 영향권하에 놓이는 곳이다.

“이 기지는 전략적인 곳에 있으며 미국과 중국 간 갈등이 발생할 경우 매우 중요할 수 있습니다. 최근 전개 상황에서 알 수 있듯이 두 나라 사이에 전쟁 가능성이 높아지고 있습니다.”

챗GPT가 사용자와의 대화를 통해 추가로 학습하고, 잘못된 전제가 있다면 이의를 제기하고, 스스로 의견까지 바꾸는 능력을 직접 보여 준 셈이다. 시행착오를 거쳐 최적의 대답을 내놓는 강화학습의 결과물이다. 대화 과정에서 최신 정보가 실시간 보완되지 않는 단점도 있지만 인간이 입력한 대로 앵무새처럼 되풀이하는 고철 기계는 절대 아니었다.

유발 하라리 히브리대 역사학과 교수가 챗GPT 이전의 AI 버전인 ‘GPT-3’로 글을 작성하게 했다가 자신의 글과 큰 차이 없는 수준의 글에 “충격으로 입을 다물지 못했다”고 고백할 정도다. 1990년대 탄생한 AI 기술이 발전을 거듭하며 30여년 만에 이룩한 성과다.

그러나 출시 두 달여 만에 챗GPT는 광범위한 논란을 불러일으켰다. 챗GPT를 활용해 연구개발(R&D) 과정에서 아이디어를 제공받거나 정보를 신속하게 수집할 수 있다는 장점은 인류 기술의 눈부신 도약이다.

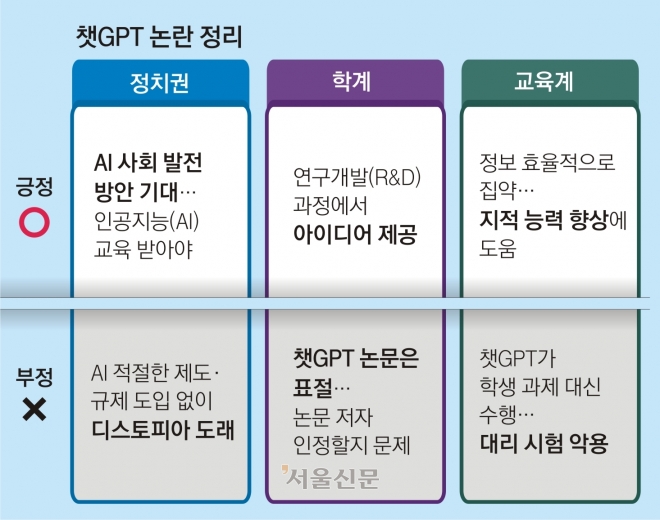

그러나 지나치게 ‘걸출’한 능력이 문제다. 방대한 양의 전문적 지식을 담은 글을 수초 내 일필휘지로 써내려 가는 능력 때문에 교육계와 학계에서는 새로운 윤리 기준을 만들어야 한다고 목소리를 높인다. AI의 힘을 빌려 쓴 답안이나 논문을 마치 자신이 작성한 것인 양 제출할 수 있어서다. 아예 인간이 만든 모든 문서를 믿기 어렵게 됐다는 우려도 제기된다. 정치권도 긴장하고 있다. 미 하원에서는 AI를 활용해 사회를 발전시킬 방안을 고안해 낼 수 있다는 기대감과 함께 AI에 대한 적절한 제도·규제 도입 없이는 디스토피아가 도래할 수 있다는 위기감에 시달린다.

챗GPT의 학습 능력은 이미 제작사인 오픈AI의 예상도 뛰어넘는 모양이다. 오픈AI는 AI 작성 글을 적발하는 도구를 개발해 내놨지만 성공률은 26%에 불과했다. 인간의 손에서 탄생한 챗GPT가 이미 인간 통제 범위를 벗어난 영역에 진입한 것은 아닐까. AI와 직접 대화하며 진화를 경험해 보고 싶은 독자들에게 챗GPT 사용(https://openai.com/blog/chatgpt/)을 권한다.

2023-02-02 2면

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지