기술오용·통제력 상실 등 집중 대응

“규제 아닌 국내 기업 경쟁력 지원”

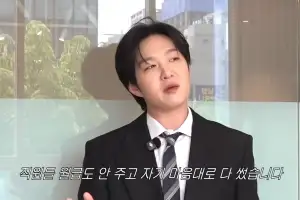

27일 경기 성남시 판교글로벌R&D센터에서 열린 AI 안전연구소 개소식에 김명주 소장이 참석하고 있다. 2024.11.27 연합뉴스

가짜뉴스나 딥페이크 범죄, 사이버 공격 등 인공지능(AI) 악용에서 비롯된 잠재적 위험을 막기 위한 연구 전담 조직 ‘AI 안전연구소’가 출범했다.

과학기술정보통신부는 27일 경기 성남시 글로벌 연구개발(R&D)센터에서 ‘AI 안전연구소’ 개소식을 열었다. 지난 5월 AI 서울정상회의 당시 윤석열 대통령이 “AI안전연구소를 설립해 글로벌 AI 안전성 강화를 위한 네트워크에 동참할 것”이라고 밝힌 데 따른 것이다.

연구소는 AI의 기술적 한계, 인간의 AI 기술 오용, AI 통제력 상실 등으로 일어날 수 있는 위험에 체계적·전문적으로 대응하기 위해 세워졌다. 국가 단위의 AI 안전 정책 및 기술 연구를 진행하고, 국내 기업의 해외 진출도 돕는다. 히말라야 등반자들이 셰르파의 도움을 받아 안전하게 산에 오르듯 우리 기업이 글로벌 AI 경쟁에서 정상으로 나아갈 수 있도록 돕는다는 의미다.

정부는 AI 안전연구소는 아시아태평양지역을 대표하는 글로벌 AI 안전 거점연구소로 키워갈 방침이다. ▲AI 안전 평가 ▲AI 안전 정책 연구 ▲AI 안전 글로벌 협력 ▲AI 안전 연구개발(R&D) 등이 4대 핵심과제다.

정책 협력 및 기술 연구를 위해 AI 안전연구소는 이날 삼성전자·네이버·카카오·SK텔레콤·KT·LG AI연구원 등 산학연 24곳과 ‘대한민국 AI 안전 컨소시엄’ 업무협약(MOU)을 맺었다. 김명주 AI 안전연구소장은 “규제 기관이 아니라 국내 AI 기업들이 글로벌 경쟁력을 확보하는 데 장애가 되는 위험 요소를 최소화하도록 지원하는 협력 기관 역할을 하겠다”고 말했다.

2024-11-28 16면

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지

![THE NEXT : AI 운명 알고리즘 지금, 당신의 운명을 확인하세요 [운세 확인하기]](https://img.seoul.co.kr/img/n24/banner/ban_ai_fortune.png)